Un certo numero di aziende tra cui Microsoft і Facebook, e persino i ricercatori della University of Southern California, stanno sviluppando tecnologie per combattere i deepfake e prevenirne la diffusione da parte dei media gialli e della disinformazione in generale. Tuttavia, un gruppo di scienziati è comunque riuscito a ingannarli.

Un team di informatici dell'Università della California, a San Diego, ha avvertito che è ancora possibile ingannare i sistemi di rilevamento deepfake esistenti inserendo dati di input chiamati "esempi concorrenti" in ogni fotogramma video. Gli scienziati hanno presentato i loro risultati alla Computer Vision Conference WACV 2021, tenutasi online il mese scorso.

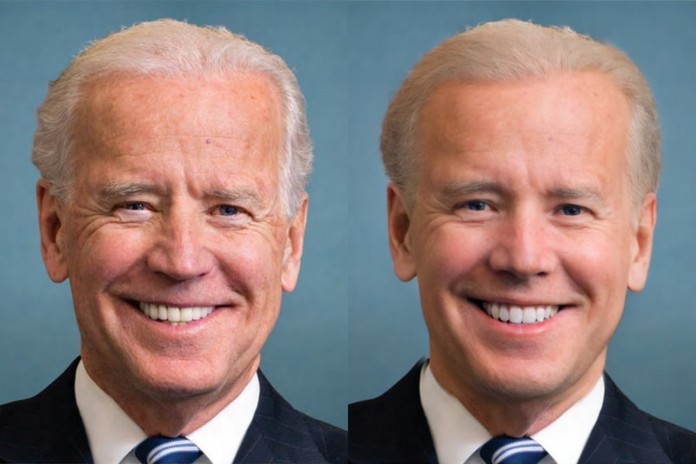

Esempi concorrenti sono input leggermente alterati che fanno sì che i sistemi di intelligenza artificiale, come i modelli di apprendimento automatico, commettano errori. Inoltre, il team ha dimostrato che l'attacco funziona ancora dopo aver compresso il video. Nel video sopra, gli scienziati mostrano che XceptionNet, un rilevatore di deepfake, etichetta il loro video in competizione come "reale".

La maggior parte di questi rilevatori funziona tracciando i volti in un video e inviando i dati dei volti ritagliati a una rete neurale per l'analisi. La rete neurale analizzerà quindi questi dati e troverà elementi che di solito sono scarsamente riprodotti nei deepfake, come lo sfarfallio.

Inserendo esempi concorrenti, i ricercatori hanno scoperto che potevano ingannare questi rilevatori di deepfake facendogli credere che i video fossero reali.

Affermano nel documento che "per utilizzare questi rilevatori di deepfake nella pratica, è importante valutarli rispetto a un avversario adattivo che è consapevole di questa protezione e cerca deliberatamente di infrangerla. Dimostriamo che i moderni metodi di rilevamento dei deepfake possono essere facilmente aggirati se l'attaccante è completamente o anche parzialmente consapevole del rilevatore".

Come hanno dimostrato questi scienziati, le tecnologie di automazione sviluppate per combattere la disinformazione potrebbero non essere ancora all'altezza del compito.

Leggi anche: